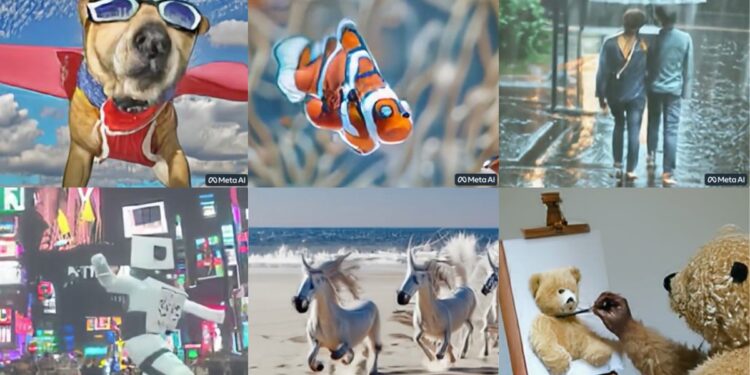

كشفت Meta النقاب عن نموذج ذكاء اصطناعي مجنون يسمح للمستخدمين بتحويل أوصافهم المكتوبة إلى فيديو. يُطلق على النظام اسم Make-A-Video وهو الأحدث في اتجاه المحتوى الذي تم إنشاؤه بواسطة AI على الويب.

يقبل النظام أوصافًا قصيرة مثل “روبوت يتصفح موجة في المحيط” أو “سمكة المهرج تسبح عبر الشعاب المرجانية” وينشئ ديناميكيًا صورة GIF قصيرة للوصف. هناك ثلاثة أنماط مختلفة من مقاطع الفيديو للاختيار من بينها: سريالية وواقعية ومنمقة.

وفقًا لما نشره الرئيس التنفيذي لشركة Meta ، Mark Zuckerberg ، على Facebook ، فإن ترجمة النص المكتوب إلى فيديو أصعب بكثير بسبب كيفية احتياج الفيديو للحركة:

“من الصعب جدًا إنشاء فيديو مقارنة بالصور لأنه بالإضافة إلى إنشاء كل بكسل بشكل صحيح ، يتعين على النظام أيضًا توقع كيفية تغيرها بمرور الوقت. يحل Make-A-Video هذا عن طريق إضافة طبقة من التعلم غير الخاضع للإشراف التي تمكن النظام من فهم الحركة في العالم المادي وتطبيقها على إنشاء النص التقليدي للصورة “.

كتب فريق أبحاث الذكاء الاصطناعي في Meta ورقة تصف كيفية عمل النظام وكيف يختلف عن الأساليب الحالية لتحويل النص إلى صورة (T2I). على عكس نماذج لغة الآلة الأخرى ، لا تستخدم طريقة Meta Text-to-Video (T2V) أزواج نص فيديو محددة مسبقًا. على سبيل المثال ، لا يقترن “رجل يمشي” بفيديو لرجل حقيقي يمشي.

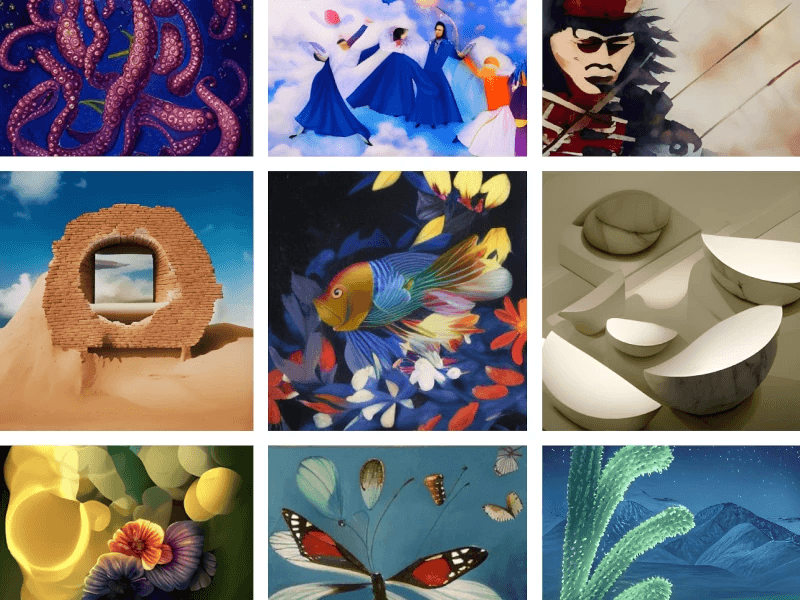

إذا كان هذا يشبه إلى حد كبير DALL-E ، تطبيق T2I الشهير ، فلن تكون بعيدًا. تم طرح تطبيقات T2I الأخرى منذ أن اكتسب DALL-E شهرة. أصدرت TikTok مرشحًا في أغسطس يسمى AI Greenscreen يقوم بإنشاء صور بأسلوب الرسم بناءً على الكلمات التي تكتبها.

أصبح المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي موضع اهتمام كبير خلال السنوات القليلة الماضية. تستخدم تقنية Deepfake ، وهي تقنيات التعلم الآلي لاستبدال وجه شخص بآخر ، حتى في استوديوهات المؤثرات المرئية لعروض الميزانية الكبيرة مثل The Mandalorian.

في يوليو / تموز ، نشرت صحيفة The Times تقريرًا خاطئًا عن امرأة أوكرانية في خضم الحرب الروسية الأوكرانية. المشكلة أنها لم تكن حقيقية.

ربما لا يمثل تهديد الذكاء الاصطناعي تهديدًا حقيقيًا ، لكن مشاريع مثل DALL-E و Make-A-Video هي استكشافات ممتعة لبعض الاحتمالات المثيرة للاهتمام.